説明可能AI(XAI)の実現に向けてー信頼性・安全性を担保するためにはー

AIの活用が進む中で、「なぜその判断に至ったのか」を人間が理解できることが重要視されています。

とくに製造業の現場では、品質検査AIや不良品検知システムなどでAIの判断根拠が不明確だと、安全性や信頼性に課題が生じます。

本ブログでは、説明可能AI(XAI)の最新動向と技術的背景、そしてAIによる画像認識を活用する製造業DXの現場でのメリット・注意点を解説していきます。

はじめに:AIが「説明できる」ことの重要性

AIの判断が人間の理解を超える“ブラックボックス”であることは、長年の課題です。

とくに製造業のAI導入が進む中で、「なぜ不良品と判断したのか」「異物混入検知の根拠はどこか」といった説明が求められるケースが増えています。

AIが出す結果をそのまま鵜呑みにするのではなく、AI画像判断の理由を可視化し、信頼できるAIシステムを構築することが、今後の製造業DXの中核になります。

このような背景から、Explainable AI(XAI)=説明可能AIが注目されています。XAIとは、AIモデルの予測や判断を人間が理解できる形で説明する技術の総称であり、「AIによる画像認識 課題」や「品質検査AIの信頼性向上」に直結する概念です。

説明可能AI(XAI)/信頼性・安全性を担保するための技術とは

1. XAIの基本技術と仕組み

XAIでは、「AIがなぜその判断をしたのか」を数値・可視化・言語化のいずれかで提示します。代表的な手法としては以下のようなものがあります。

- LIME(Local Interpretable Model-agnostic Explanations):

AIが出した結果の周囲で「擬似的に理解しやすいモデル」を構築し、重要な特徴量を示します。

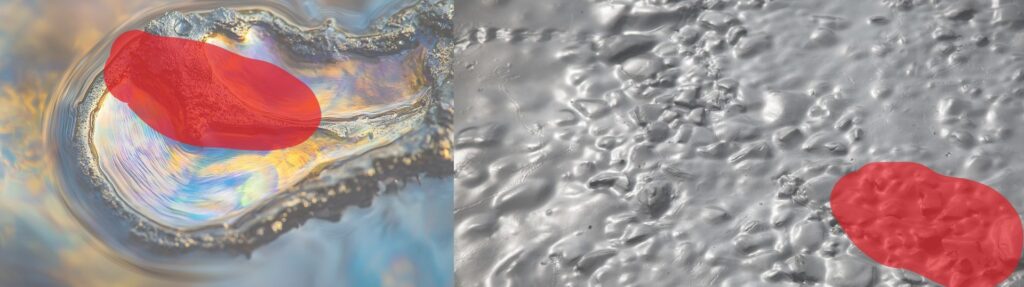

画像認識AIでは、不良品と判断された箇所をヒートマップで可視化するなどの応用が可能です。 - SHAP(SHapley Additive exPlanations):

ゲーム理論に基づき、AIの予測に各特徴がどの程度貢献したかを定量化します。

異物混入検知の精度を分析する際、「照明条件」「反射率」「形状特徴」などが判断にどう寄与したかを可視化できます。 - Grad-CAM(Gradient-weighted Class Activation Mapping):

深層学習モデルの中間層を解析し、AIが注目した画像領域を可視化する技術です。

製造業のAI画像判断では、不良部品や異常箇所をヒートマップで直感的に把握する際に有効です。

2. 技術的な根拠と論文動向

代表的な論文としては、以下が挙げられます。

- Ribeiro et al., “Why Should I Trust You?” Explaining the Predictions of Any Classifier (KDD, 2016)

- Lundberg & Lee, “A Unified Approach to Interpreting Model Predictions” (NeurIPS, 2017)

- Selvaraju et al., “Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization” (ICCV, 2017)

近年ではNVIDIAやGoogleなどが、Explainable Vision AIの分野を強化しています。

とくにNVIDIAのMetropolisやTAO Toolkitでは、製造業やスマートファクトリーで用いられる画像認識AIの判断根拠をヒートマップや特徴マップとして可視化する仕組みが進化しています。

Best Practices: Explainable AI Powered by Synthetic Data(NVIDIA DEVELOPER Technical Blog)

適用想定シーンとそのメリット

1. 製造業の品質検査や不良品検知

製造ラインでのAI導入では、カメラ映像をもとにAIによる画像認識で異常を検知します。

このとき、AIがどの領域をもとに「不良品」と判断したかを説明できると、品質保証部門が納得できるエビデンスになります。

とくに「画像認識 課題」として指摘されがちな「判断の再現性」や「異常領域の曖昧さ」を補完できるのが、XAIの大きな強みです。

2. 工場異常検知・受水槽点検などのインフラ点検

工場内での異常音検知や受水槽点検のように、人が立ち入れない・観察しづらい領域をAIが代替するケースでも、XAIが役立ちます。

AIが「どの温度・振動・画像領域を異常と見なしたのか」を明示することで、現場担当者の信頼性向上と誤検知リスクの低減が期待できます。

3. 異物混入検知・食品・薬品分野

食品製造ラインでは異物混入検知の精度が直接安全性に関わるため、XAIによる根拠提示が不可欠です。

AIが検知した「異物の色・形・反射特性」などの要因を説明できれば、品質クレーム対応や再発防止にも活用できます。

デメリットや注意点

説明可能AIには多くの利点がありますが、いくつかの課題も存在します。

- 説明の誤解リスク

ヒートマップやスコアが正しく解釈されず、「AIがここを異常と誤って判断した」と誤解されることがあります。

XAIは「説明を生成するAI」であり、常に真の理由を完全に表しているわけではありません。 - 演算コスト・開発コスト

LIMEやSHAPなどは説明生成に追加計算が必要であり、リアルタイム検査では処理負荷が課題です。

このため、製造業DXの推進においても“説明精度”と“リアルタイム性”の両立がポイントになります。 - モデルのセキュリティとプライバシー

説明可能性のために内部構造を開示しすぎると、AIモデルの知的財産やセキュリティリスクが増します。

たとえば、画像認識AI会社が外部に提供するAPIでは、説明情報の範囲を制御する設計が必要です。

まとめ:信頼できるAIが製造業DXを加速

AIがビジネスの意思決定を支える時代、「精度」だけではなく「説明性」も競争力の指標になっています。

とくに、品質検査AIや異物混入検知、不良品検知などでは、AIの判断根拠を明示できることが顧客や監査対応に直結します。

今後の製造業DXでは、「高精度 × 高信頼 × 高透明性」を両立するAIが求められます。

説明可能AI(XAI)は、その実現に向けた重要なステップであり、工場異常検知から受水槽点検まで、幅広い領域でAIの信頼性を高める技術として欠かせない存在になっていくでしょう。

弊社では、常に最新技術の研究開発や検証、現場ナレッジの蓄積と最適な現実解を求め、貴社に寄り添った課題解決を提案していきます。

ぜひお気軽にお問い合わせください。

Contact us

お問い合わせ

画像認識をはじめとするAIのことなら是非OkojoAIに!ご相談ベースで構いませんので、遠慮せずお気軽にお問い合わせください。